الرئيسية

أخبارعاجلة

رياضة

- أخبار الرياضة الإماراتية والعربية والعالمية

- أخبار الرياضة والرياضيين

- فيديو اخبار الرياضة

- نجوم الملاعب

- أخبار الرياضة

- ملاعب

- بطولات

- أندية الإمارات

- حوارات وتقارير

- رياضة عربية

- رياضة عالمية

- موجب

- سالب

- مباريات ونتائج

- كرة الطائرة

- كرة اليد

- كرة السلة

- رمي

- قفز

- الجري

- تنس

- سيارات

- غولف

- سباق الخيل

- مصارعة

- جمباز

- أخبار المنتخبات

- تحقيقات

- مدونات

- جمباز

ثقافة

إقتصاد

فن وموسيقى

أزياء

صحة وتغذية

سياحة وسفر

ديكور

بما في ذلك طلبات العمل والهجرة وتطبيقات الرعاية الاجتماعية

خبير بارز يحذر من استخدام الذكاء الاصطناعي "المتحيز" في قرارات حاسمة

الذكاء الاصطناعي

لندن - صوت الإمارات

أصدر خبير بارز في مجال الذكاء الاصطناعي تحذيرا صارخا ضد استخدام خوارزميات متحيزة جنسيا وعنصرية لاتخاذ قرارات حاسمة.وفي جميع أنحاء العالم، بدأت الخوارزميات في الإشراف على العمليات المختلفة، بما في ذلك طلبات العمل والهجرة وشروط الكفالة وتطبيقات الرعاية الاجتماعية.حتى أن الباحثين العسكريين يستكشفون ما إذا كانت تقنية التعرف على الوجه، يمكن أن تمكّن طائرات الدرون من تحديد أهدافها الخاصة.وفي حديثه مع صحيفة "الغارديان"، قال نويل شاركي، خبير الكمبيوتر في جامعة شفيلد البريطانية، إن هذه الخوارزميات مميزة بالتحيزات ولا يمكن الوثوق بها.ويدعو البروفيسور شاركي إلى إجراء اختبارات قوية قبل استخدام الذكاء الاصطناعي، في الأماكن العامة.

وقال موضحا: "يجب أن تكون هناك سيطرة على جميع الخوارزميات التي تؤثر على حياة الناس، لماذا؟ لأنها لا تعمل وثبت أنها متحيزة في كافة المجالات. وهناك الكثير من التحيزات التي تحدث الآن، من المقابلات الوظيفية إلى الرعاية الاجتماعية وتحديد من يدخل السجن".

وكشفت صحيفة "الغارديان" أن البروفيسور شاركي أجرى مناقشات مع بعض المؤسسات الرائدة في مجال التكنولوجيا ووسائل التواصل الاجتماعي في العالم - بما في ذلك "فيسبوك" و"غوغل" - حول التحيز الذي نراه حاليا في الذكاء الاصطناعي.

وقال شاركي: "إنهم يعلمون أنها مشكلة وعملوا بإنصاف لإيجاد حل خلال السنوات القليلة الماضية، ولكن لم يجدوا أي حل حتى الآن. إلى أن يجدوا هذا الحل، فإن ما أرغب في رؤيته هو اختبار على نطاق واسع على غرار اختبارات المستحضرات الصيدلانية".

ويتطلب ذلك اختبار هذه الأنظمة وصقلها بـ مئات الآلاف أو ملايين الأشخاص، حتى لا تظهر أي انحياز داخلي. وأوضح شاركي أن الخوارزميات يجب أن تخضع للاختبارات الصارمة نفسها، التي يخضع لها أي عقار جديد يُنتج للاستهلاك البشري.

كما أشار شاركي إلى أن اهتمامه بالتحيز الحسابي يتداخل مع عمله السابق في حملته ضد الأسلحة الذاتية، وما يسمى بـ "الروبوتات القاتلة". وقال: "الآن أصبحت الفكرة الجديدة المتمثلة في إمكانية إرسال أسلحة ذاتية التحكم، دون أي سيطرة بشرية مباشرة، وإيجاد هدف فردي عن طريق التعرف على الوجه، أكثر خطورة"

قــــد يهمـــــــــك أيضًــــــــــا:

GMT 08:07 2019 الإثنين ,16 كانون الأول / ديسمبر

أحمد بن سعيد آل مكتوم يؤكد أن إكسبو دبي سيكون مهرجاناً للخيال وملهماً للابتكارGMT 05:49 2019 الإثنين ,16 كانون الأول / ديسمبر

تراجع الهجمات التي استهدفت المواقع الإلكترونية في الإمارات بنسبة 17.2 %GMT 05:45 2019 الإثنين ,16 كانون الأول / ديسمبر

"جوجل" تطلق أداة ترجمة فورية معتمدة للأجهزة الذكيةGMT 12:29 2019 السبت ,14 كانون الأول / ديسمبر

الكشف عن السبب الحقيقي لانقراض الديناصورات وحيوانات أخرىGMT 11:47 2019 السبت ,14 كانون الأول / ديسمبر

اكتشاف أعمق نقطة في اليابسة على سطح الكرة الأرضية28 سفينة عبرت مضيق هرمز خلال 24 ساعة بالتنسيق مع البحرية الإيرانية

طهران - صوت الإمارات

أعلنت بحرية الحرس الثوري الإيراني أن 28 سفينة عبرت مضيق هرمز خلال 24 ساعة الماضية بالتنسيق معها، في تطور جديد يتعلق بحركة الملاحة في أحد أهم الممرات البحرية في العالم. وأكدت جهات إيرانية أن جميع السفن وناقلات النفط م...المزيدكريم عبدالعزيز يكشف أن "الفيل الأزرق" أجرأ خطوة في مسيرته الفنية

القاهرة - صوت الإمارات

أكد الفنان كريم عبد العزيز أن مشاركته في فيلم "الفيل الأزرق" تمثل أهم محطة فنية في مشواره، واصفاً تجسيده لشخصية الدكتور يحيى بأنه القرار الأكثر جرأة الذي اتخذه خلال مسيرته المهنية الممتدة لسنوات طويلة. وأوضح �...المزيدانفجار نيزك في سماء شمال شرق الولايات المتحدة يثير ذعر السكان

واشنطن ـ صوت الإمارات

شهدت سماء شمال شرق الولايات المتحدة ظاهرة فلكية لافتة بعد انفجار نيزك أثناء دخوله الغلاف الجوي، ما تسبب في دوي قوي هز مناطق واسعة وأثار حالة من القلق بين السكان في عدة ولايات. وأوضحت وكالة الفضاء الأمريكية أن النيز...المزيدهيئة الشارقة للآثار تستعرض كنوزها ومكتشفاتها في معرض وارسو الدولي للكتاب

وارسو - صوت الإمارات

تشارك هيئة الشارقة للآثار في فعاليات معرض وارسو الدولي للكتاب 2026 ضمن جناح إمارة الشارقة، التي تحل ضيف شرف على الحدث الثقافي، في مشاركة تعكس الحضور المتنامي للإمارة على الساحة الثقافية العالمية وترسخ مكانتها كمركز...المزيدمنتخب مصر يجهز صلاح لقيادة الفراعنة أمام البرازيل استعدادًا للمونديال

القاهرة - صوت الإمارات

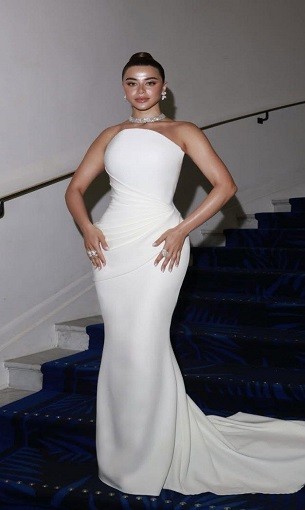

يواصل الجهاز الفني لمنتخب مصر استعداداته المكثفة لخوض المواجهة الودية المرتقبة أمام البرازيل، ضمن البرنامج التحضيري الأخير قبل انطلاق كأس العالم 2026، مع التركيز على تجهيز محمد صلاح لقيادة المنتخب في اللقاء المرتق...المزيديارا السكري تخطف الأنظار بإطلالات راقية في مهرجان كان 2026

القاهرة - صوت الإمارات

واصلت يارا السكري تأكيد حضورها كواحدة من أكثر النجمات الشابات أناقة خلال مشاركتها في فعاليات مهرجان كان السينمائي 2026، حيث لفتت الأنظار بسلسلة من الإطلالات الراقية التي جمعت بين البساطة والفخامة، واعتمدت خلالها تصاميم مجسّمة أبرزت رشاقتها بأسلوب أنثوي ناعم وعصري. وفي أول ظهور لها على السجادة الحمراء للمهرجان، تألقت يارا بفستان أبيض طويل بدون أكمام بقصة مستقيمة مجسّمة، تميز بتفاصيل الدرابيه الهندسية عند منطقة الخصر وانسدل بذيل ناعم منح الإطلالة طابعاً ملكياً راقياً. ونسقت معه مجوهرات ماسية فاخرة وتسريحة الكعكة العالية مع مكياج نيود هادئ ركز على إبراز ملامحها الطبيعية. كما ظهرت خلال إحدى الأمسيات الخاصة بإطلالة سوداء كلاسيكية، اختارت فيها فستاناً مجسماً بقصة الكورسيه والكتفين المكشوفين، مع ياقة هندسية عصرية أضافت لمسة �...المزيد Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

أرسل تعليقك